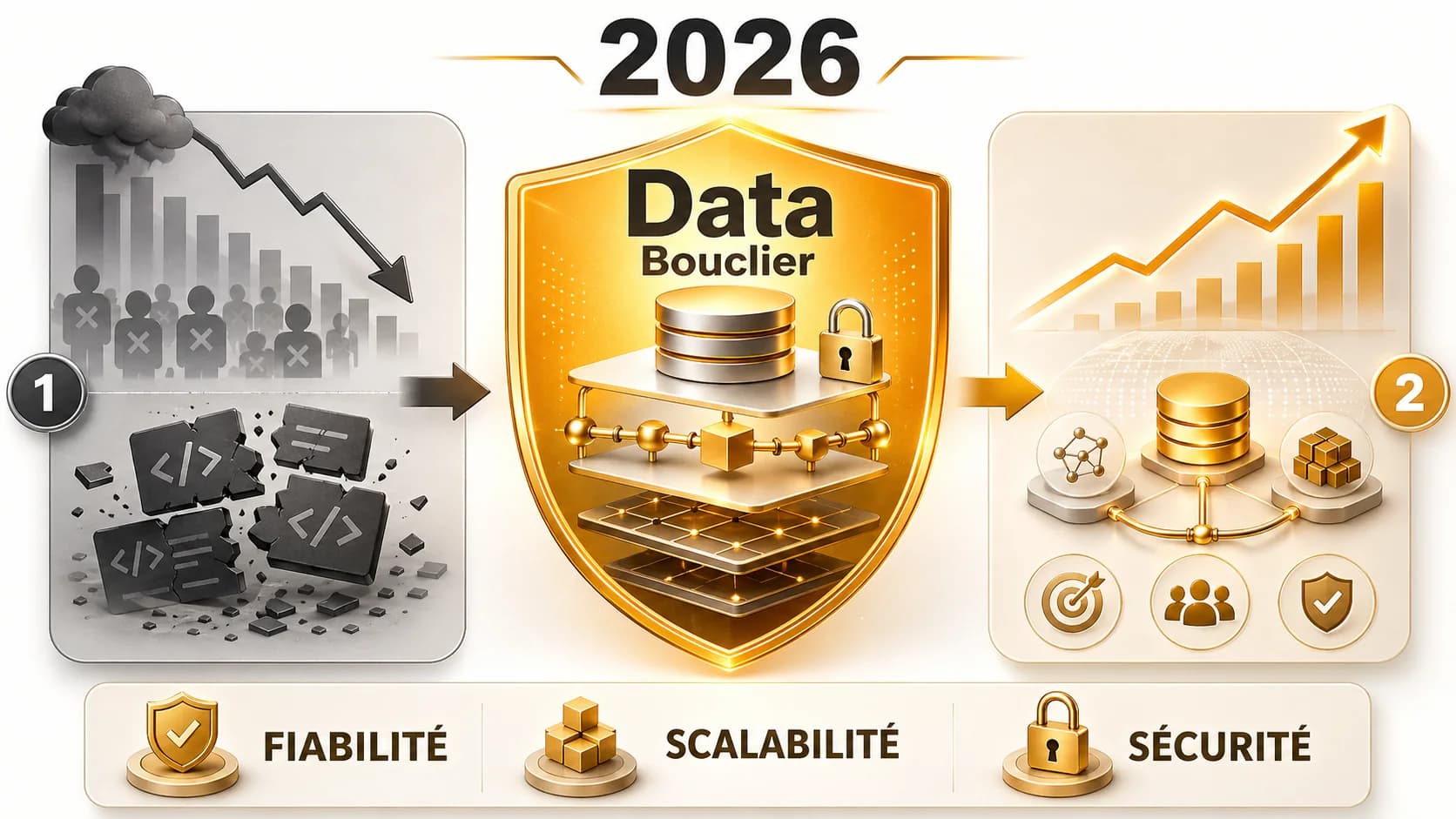

Développeur 2026 : L''Architecture de Données, Votre Bouclier Anti-Crise

Face aux licenciements tech, l'architecture de données protège votre emploi. Voici pourquoi cette compétence est cruciale en 2026 et comment l'acquérir.

Équipe carrières.dev

Équipe éditoriale

Début février 2026, l'écosystème tech français est sous tension. Des restructurations dans des scale-ups, relayées par BFM Business, créent un climat d'incertitude. Pourtant, un signal est clair sur les plateformes d'emploi : la demande pour les profils maîtrisant l’architecture de données (Data Architect, Data Platform Engineer) ne baisse pas, elle monte.

Pourquoi cette différence ? Certains développeurs deviennent "indispensables" quand d'autres semblent "interchangeables". La raison est simple : les données sont désormais le centre stratégique des applications. En période économique difficile, les entreprises concentrent leurs investissements sur ce qui crée un avantage concurrentiel durable : exploiter leurs données de façon fiable, scalable et sécurisée.

Cet article analyse les tendances du marché et propose un plan d'action. Nous expliquons pourquoi les compétences en architecture de données sont votre meilleure protection en 2026, et comment les acquérir pour sécuriser votre carrière.

Le Grand Découplage : Pourquoi l'Architecture de Données Résiste aux Turbulences

En bref : Les postes Data Architect/Data Platform Engineer progressent de 4 % en 2025 selon l'APEC alors que les offres dev génériques chutent de 80 % — l'INSEE recense 945 000 cadres numériques, mais moins de 12 % maîtrisent l'architecture données.

Les licenciements de 2026 ne sont pas aléatoires. Ils visent les équipes dont les projets sont jugés non-critiques, trop coûteux, ou dont les compétences sont devenues courantes. À l’inverse, les rôles liés aux données sont souvent préservés, parfois renforcés. Trois raisons expliquent cette résistance.

1. La Donnée, Nouveau Pétrole (et Nouveau Moteur de Survie)

La métaphore est connue, mais la réalité est économique. Dans un marché tendu, la capacité à optimiser les coûts et créer de la valeur passe par les données. L’INSEE estime que le secteur numérique représente 5,5 % du PIB français en 2025, et la donnée en est le carburant. Un développeur qui comprend comment construire et maintenir cette infrastructure n’est pas un centre de coût, il est un multiplicateur de valeur. Il aide à identifier les goulots d’étranglement, à personnaliser l’expérience client pour les retenir, et à automatiser les décisions. Selon Glassdoor, un Data Platform Engineer gagne entre 62 000 € et 78 000 € brut annuel en Ile-de-France. Ces leviers dépendent directement de la qualité de l’infrastructure sous-jacente.

2. L'Effet Multiplicateur de l'IA Générative

L'engouement pour l'IA générative a rappelé un principe basique : "Garbage in, garbage out". Les modèles les plus sophistiqués échouent avec des données de mauvaise qualité, dispersées. Les entreprises comprennent que leur investissement en IA est conditionné par un investissement préalable dans leur plateforme de données. Cela génère une demande forte pour des compétences permettant de construire des pipelines robustes pour l’entraînement des modèles, ou d’implémenter des architectures modernes comme le Data Mesh pour rendre les données accessibles et gouvernées.

3. La Fin du Développeur "Exécutant" et l’Avènement du Développeur "Architecte"

La barre est plus haute. Écrire du code fonctionnel ne suffit plus. Les entreprises veulent des développeurs qui pensent système, impact business et durabilité technique. La grille Syntec au coefficient 170-210 reflète cette évolution : un architecte données se situe 20 à 35 % au-dessus d’un développeur fullstack généraliste de même ancienneté. L’architecture de données incarne cette compétence "méta". Elle demande une vision transverse (métier, légal, technique), a un impact à long terme, et reste rare. Beaucoup plus de développeurs savent coder une API CRUD que concevoir un schéma d’événements scalable. Face aux licenciements, les entreprises gardent les talents qui comprennent et construisent les fondations de leur avenir. L’APEC confirme que les offres "architecte données" affichent un salaire médian de 72 000 € brut, contre 52 000 € pour un fullstack généraliste.

Cartographie des Compétences "Bouclier" en 2026

En bref : Maîtrisez Data Mesh + Event-Driven Architecture en concepts, AWS/Terraform + Airflow en outils, et communication business en transverse — Stack Overflow confirme que Terraform est utilisé par 36,5 % des devs, un standard de facto.

Sur quoi vous concentrer ? Voici une cartographie des compétences les plus recherchées et résilientes, basée sur l’analyse des offres d’emploi et les retours de recruteurs.

Les Concepts Architecturaux à Maîtriser (Le "Pourquoi")

Pour rester pertinent, vous devez comprendre les paradigmes qui structurent les systèmes de données modernes, pas seulement les outils. Ces concepts expliquent le "pourquoi" des choix techniques et sont transférables d'une stack à l'autre. Sans cette compréhension, vous risquez de suivre des modes sans créer de valeur durable.

- Data Mesh : Passer d'une plateforme de données centrale et monolitique à une architecture décentralisée. Les équipes de domaine deviennent responsables de leurs données en tant que produits. Maîtrisez les quatre principes : Domain Ownership, Data as a Product, Self-Serve Platform, et Federated Governance.

- Data Fabric : Une couche d'abstraction qui permet un accès unifié aux données, où qu'elles soient stockées (cloud, on-premise). C'est une réponse pragmatique à la complexité des paysages data existants, souvent hérités.

- Event-Driven Architecture (EDA) & Streaming : Modéliser les données comme des flux d'événements en temps réel (avec Kafka, Pulsar) plutôt que comme des bases statiques. Essentiel pour les applications modernes qui doivent réagir immédiatement.

- Data Governance & Observability : Mettre en place des métadonnées, des lignages (data lineage) et des outils de qualité. C'est la base de la confiance dans les données. Sans gouvernance, les données deviennent un risque, pas un actif.

Les Outils et Technologies à Pratiquer (Le "Comment")

La maîtrise pratique d'outils spécifiques valide votre compréhension des concepts. Privilégiez la profondeur sur un cloud plutôt que la superficialité sur plusieurs. Un recruteur préfère un expert AWS qu'un généraliste qui a "touché à tout".

- Cloud & Infra-as-Code : Une maîtrise approfondie d'un cloud (AWS, GCP, Azure) et de ses services data est non-négociable. AWS domine le marché français. Couplez cela avec Terraform ou Pulumi pour gérer l'infrastructure en code. Selon le Stack Overflow Survey 2024, Terraform est utilisé par 36.5% des développeurs professionnels, confirmant son statut de standard.

- Orchestration & Workflow : Apache Airflow reste le leader pour orchestrer des pipelines complexes. Prefect et Dagster gagnent du terrain pour leur expérience développeur améliorée. Savoir modéliser des dépendances entre tâches est une compétence clé.

- Format & Modélisation : Travaillez avec des formats columnaires comme Parquet pour le stockage efficace. Comprenez les modèles en étoile/flocon pour les data warehouses. Une connaissance du Data Vault 2.0 est un plus pour les projets d'entreposage de données historisées.

- Langages : SQL est incontournable. Python est essentiel pour le scripting, l’automatisation et les frameworks data. Une compréhension de l'écosystème JVM (Scala/Java) est précieuse pour travailler avec Apache Spark à grande échelle.

Les Compétences Transverses (Le "Et Avec Qui")

Votre valeur technique est multipliée par votre capacité à collaborer et à aligner votre travail sur les objectifs de l'entreprise. Un architecte de données isolé est inefficace.

- Communication & Storytelling : Expliquez l'impact d'un mauvais schéma de données en termes de coût ou de perte d'opportunité business. Utilisez des métaphores simples.

- Product Thinking : Traitez un "dataset" ou une "API de données" comme un produit. Identifiez ses utilisateurs, son cycle de vie, et mesurez sa satisfaction. Cela change radicalement votre approche.

- Gouvernance & Conformité : Ayez des notions solides de RGPD et des principes de sécurité (ex : principe du moindre privilège). Dans les secteurs régulés (banque, santé), c'est primordial.

Votre Plan d'Action en 5 Étapes pour 2026

En bref : Audit de stack, certification AWS Data Engineer, projet data interne chiffré, preuve sociale (blog + meetups), puis négociation avec les données Glassdoor et Syntec — un Data Engineer senior vise 66 000–75 000 € brut en IDF.

Passer de développeur "à risque" à développeur "bouclier" demande une stratégie. Voici une feuille de route concrète, testée par des membres de notre communauté.

Étape 1 : Évaluer Votre Position Actuelle et Votre Marché

Avant d’investir du temps, faites un audit honnête de vos compétences et du marché pour identifier le chemin le plus efficace vers votre objectif. Ne présumez pas de ce qui est demandé, vérifiez.

- Analysez votre stack actuelle : Travaillez-vous déjà sur des pipelines, des warehouses, des APIs de données ? Même à petite échelle, c'est un point de départ valable. Listez ces expériences.

- Étudiez les offres d’emploi cibles : Sur LinkedIn, Welcome to the Jungle, consultez les offres pour "Data Engineer", "Data Architect", "Analytics Engineer". Notez les exigences récurrentes en outils et concepts. Notre hub dédié au développement suit aussi ces tendances.

- Calculez votre valeur sur le marché : Utilisez notre outil Calculer Mon Salaire pour connaître la fourchette salariale de ces rôles en 2026. L'Observatoire de l'APEC montre une demande soutenue pour les ingénieurs données, avec des salaires souvent 15 à 25% supérieurs aux rôles de développement web généraliste en région parisienne. Pour une vision détaillée, notre grille salariale 2026 est une référence. Consultez aussi le hub salaires et les fourchettes par ville (Paris, Lyon) pour affiner votre positionnement.

Étape 2 : Acquérir les Fondamentaux de Manière Ciblée

Ne tentez pas de tout apprendre. Choisissez un chemin cohérent et allez en profondeur. La spécialisation est plus valorisée que la superficialité. J'ai personnellement conseillé des développeurs qui ont perdu six mois à "toucher à" cinq technologies différentes sans maîtriser aucune.

- Option A (Le Spécialiste Cloud) : Choisissez un cloud provider. AWS est le plus demandé. Passez la certification AWS Certified Data Engineer - Associate. Construisez un projet qui utilise Glue (ETL), Athena (query), Redshift (warehouse) et Lake Formation (gouvernance). La documentation AWS est excellente.

- Option B (Le Spécialiste Data Mesh/Modern Stack) : Lisez les articles fondateurs de Zhamak Dehghani sur le Data Mesh. Pratiquez en montant un mini-mesh sur un cloud avec des domaines fictifs (ex : "Sales", "Support"). Utilisez DataHub (open source de LinkedIn) pour le catalogage. C'est l'outil que nous utilisons en interne pour gérer nos métadonnées.

- Ressource clé : Le livre "Fundamentals of Data Engineering" de Joe Reis et Matt Housley est excellent pour structurer vos connaissances. Il couvre à la fois la théorie et la pratique.

Étape 3 : "Productiser" Votre Expérience Actuelle

Vous n’avez pas besoin de changer de poste pour commencer à bâtir une expérience pertinente. Identifiez un problème data dans votre équipe actuelle et résolvez-le. C'est la méthode la plus puissante pour apprendre et prouver votre valeur.

- Identifiez un problème : Un dashboard qui met 30 secondes à charger ? Des données incohérentes entre deux outils ? Un processus manuel d'extraction Excel chaque lundi matin ?

- Proposez et implémentez une solution : Même petite. Un script Python qui nettoie et consolide des fichiers. Un pipeline Airflow simple qui automatise l'extraction. Un catalogue de métadonnées basique avec DataHub. Documentez-le comme un "projet produit" : contexte, solution, résultats.

- Mesurez l’impact : "Temps de chargement réduit de 30s à 2s". "Économie de 5 heures homme par semaine". "Réduction de 95% des erreurs de reporting". Ces chiffres deviendront les points forts de votre CV.

Étape 4 : Construire Votre Preuve Sociale et Votre Réseau

La compétence seule ne suffit pas. Il faut la rendre visible et vérifiable. Dans un marché concurrentiel, votre réputation publique devient un actif.

- Écrivez : Rédigez un article de blog expliquant votre projet de l'étape 3. Partagez les problèmes rencontrés et comment vous les avez résolus. Publiez sur Medium, Dev.to, ou votre blog personnel. Un article bien fait attire l'attention des recruteurs.

- Participez : Engagez-vous dans des communautés data françaises (Data Kitchen, Paris Data Engineers sur Meetup). Les offres d'emploi les plus intéressantes circulent souvent dans ces réseaux avant d'être publiques.

- Contribuez : Aux projets open source liés à vos outils (documentation Airflow, petits correctifs sur DataHub). Votre profil GitHub devient une preuve de compétence technique tangible.

Étape 5 : Se Positionner et Négocier en Tant qu'Expert

Quand vous postulez ou discutez d’une promotion, changez de narrative. Parlez de l’impact business de votre travail, pas des tâches techniques. C'est ce qui justifie une rémunération plus élevée et une position protégée.

- Parlez impact, pas tâches : Remplacez "J'ai écrit des pipelines Spark" par "J'ai conçu une architecture de flux qui a réduit le temps d'accès aux données pour l'équipe marketing de 24h à 5 minutes, permettant des campagnes A/B test en temps réel et augmentant le taux de conversion de 2%."

- Mettez en avant votre vision architecturale : Dans les entretiens, discutez de gouvernance, de coût total de possession, d'évolutivité. Montrez que vous pensez au système dans son ensemble.

- Utilisez les données du marché : Lors d'une négociation salariale, appuyez-vous sur des sources comme l'étude de rémunération Hays qui, en 2025, indiquait un écart salarial pouvant atteindre 30% entre un développeur full-stack généraliste et un data engineer senior en Île-de-France. Pour préparer cette étape, nos conseils sur comment préparer sa carrière tech à l'ère de l'IA sont utiles.

Conclusion : L'Architecture de Données, Plus Qu'une Compétence, Une Mentalité

En bref : La mentalité architecte (penser systèmes, anticiper l'échelle, prioriser la fiabilité) est le vrai bouclier anti-crise — les Data Engineers gagnent 30 % de plus que les full-stack généralistes selon l'étude Hays 2025.

Les restructurations de 2026 ne sont pas la fin de la tech, mais un tournant. Elles marquent la fin d'une ère où le titre "développeur" était un sésame automatique. Elles inaugurent une ère où la valeur se mesure à la profondeur stratégique de vos compétences.

Se former à l'architecture de données, ce n'est pas juste apprendre Apache Airflow ou le Data Mesh. C'est adopter une mentalité d'architecte : penser systèmes, anticiper l'échelle, prioriser la fiabilité, et comprendre comment la technologie sert directement les objectifs business. C'est cette mentalité qui fait de vous un atout indispensable, un "bouclier anti-crise" dans la tempête.

Le marché trie les profils. De quel côté voulez-vous être ? Celui qui subit les décisions, ou celui qui les éclaire et construit les fondations de la résilience future ? L'opportunité est là. Elle demande un investissement en temps et en apprentissage, mais le retour sur investissement pour votre carrière est clair.

Prochaine étape concrète : Prenez 10 minutes pour Calculer Mon Salaire avec un profil "Data Engineer". Cette action vous donnera une vision chiffrée de l'opportunité. Ensuite, explorez les environnements propices à l'acquisition de ces compétences, que ce soit en ESN ou en Startup en 2026.

Comparez les salaires par ville (Paris, Lyon, Nantes) et par métier (Data Engineer, DevOps, développeur backend). Consultez le hub salaires pour une vue complète et les packages chez Doctolib ou Alan pour benchmarker votre positionnement.

FAQ : Vos Questions sur l'Architecture de Données et la Résilience de Carrière

En bref : Oui, les full-stack peuvent pivoter vers la data — commencez par SQL avancé + modélisation, puis certification cloud ; les ESN valorisent ces profils hybrides à 65 000–80 000 € selon l'APEC.

Q1 : Je suis développeur full-stack/web, est-ce trop tard pour me reconvertir vers l'architecture de données ?

Non, votre expérience est un atout, pas un handicap. Les développeurs full-stack comprennent le cycle de vie des applications, les APIs et ont souvent une bonne vision produit. La transition se fait en trois étapes : 1) S'intéresser aux aspects "data" de votre stack actuelle (API de données, logs, analytics). 2) Apprendre les bases du SQL avancé et de la modélisation. 3) Suivre un parcours de certification cloud axé data. Beaucoup d'architectes data performants viennent du développement applicatif.

Q2 : Data Mesh, Data Fabric, Data Lakehouse... Les concepts sont nombreux. Par où dois-je vraiment commencer ?

Commencez par les fondamentaux immuables avant les concepts à la mode. 1) SQL et modélisation relationnelle/étoile : La base de tout. 2) Les principes ETL/ELT : Comprendre l'extraction, la transformation, le chargement. 3) Un outil d'orchestration comme Airflow. Une fois ces bases solides, plongez dans le Data Mesh car c'est avant tout un changement d'organisation. Comprendre ce paradigme est plus important que de maîtriser un outil spécifique. Le Data Fabric et le Lakehouse sont des modèles d'implémentation qui peuvent suivre.

Q3 : Ces compétences sont-elles aussi valorisées dans les ESN/SSII que dans les startups/scale-ups ?

Oui, et parfois davantage. Les ESN sont sollicitées par les grands comptes pour des missions de modernisation des plateformes données, de migration cloud et de mise en conformité RGPD. Un consultant avec une double compétence dev/architecture data est très précieux. L'étude Hays note une forte demande pour ces profils en conseil. Notre guide ESN vs Startup détaille les avantages de chaque voie.

Q4 : Faut-il nécessairement viser un poste de "Data Architect" ? Quels sont les autres intitulés porteurs ?

"Data Architect" est souvent un rôle senior. Ciblez d'abord des étapes intermédiaires solides. * Data Engineer : Le métier le plus en demande, centré sur la construction des pipelines. * Analytics Engineer : À la frontière entre l'ingénierie et l'analyse, se concentre sur la modélisation des données pour les besoins business (avec dbt). * Data Platform Engineer : Spécialiste de l'infrastructure et de la plateforme de données en self-service. * Software Engineer - Data Infrastructure : Un poste de dev dans une équipe qui construit les outils data internes.

Q5 : Comment puis-je démontrer ces compétences sans expérience professionnelle directe ?

Le portfolio projet est votre meilleur atout. Construisez un projet end-to-end bien documenté. Exemple : "Analyse des prix de l'immobilier". Stack : Scraper (Python) -> Stockage (S3) -> Transformation (Spark/Glue) -> Warehouse (BigQuery) -> Orchestration (Airflow) -> Visualisation (Metabase). Ajoutez un catalogue de données avec DataHub. Publiez le code sur GitHub et écrivez un article expliquant vos choix architecturaux et les problèmes résolus. Cela vaut plus qu'une expérience vague sur un CV.

Q6 : Ces tendances sont-elles durables ou un simple effet de mode lié à l'IA ?

La tendance est structurelle, l'IA a juste accéléré l'urgence. La digitalisation génère un volume de données qui croît exponentiellement. La régulation (RGPD, AI Act) rend la gouvernance incontournable. Prendre des décisions rapides basées sur les données est vital pour la compétitivité. Même si les outils évolueront, le besoin de professionnels capables de concevoir des systèmes pour gérer, sécuriser et valoriser les données est une constante. Se former aujourd'hui, c'est investir dans une compétence critique pour la prochaine décennie.

Autres projets Doved Studio

Quelques outils complémentaires du même studio qui peuvent vous intéresser:

- Simuler Ma Retraite: Simulez ce que vous coûtera la retraite française et préparez un plan concret.

- Akademos: Tuteur IA pour enfants de 5 à 17 ans, aligné sur le programme français.

- Ralphable: Generate structured Claude Code skills that iterate until pass/fail criteria are met.

- Doved Studio: Studio indie derrière cette app et une dizaine d'autres outils.

Qu'avez-vous pense de cet article ?

Commentaires (0)

Connectez-vous pour laisser un commentaire

Se connecterSoyez le premier a commenter cet article !